CVP Customer Virtual Assistant(CVA)の設定

ダウンロード オプション

偏向のない言語

この製品のドキュメントセットは、偏向のない言語を使用するように配慮されています。このドキュメントセットでの偏向のない言語とは、年齢、障害、性別、人種的アイデンティティ、民族的アイデンティティ、性的指向、社会経済的地位、およびインターセクショナリティに基づく差別を意味しない言語として定義されています。製品ソフトウェアのユーザインターフェイスにハードコードされている言語、RFP のドキュメントに基づいて使用されている言語、または参照されているサードパーティ製品で使用されている言語によりドキュメントに例外が存在する場合があります。シスコのインクルーシブ ランゲージの取り組みの詳細は、こちらをご覧ください。

翻訳について

シスコは世界中のユーザにそれぞれの言語でサポート コンテンツを提供するために、機械と人による翻訳を組み合わせて、本ドキュメントを翻訳しています。ただし、最高度の機械翻訳であっても、専門家による翻訳のような正確性は確保されません。シスコは、これら翻訳の正確性について法的責任を負いません。原典である英語版(リンクからアクセス可能)もあわせて参照することを推奨します。

内容

はじめに

このドキュメントでは、Customer Voice Portal(CVP)CVA機能を設定する方法について説明します。

前提条件

要件

次の項目に関する知識があることが推奨されます。

- Cisco Unified Contact Center Enterprise(UCCE)リリース12.5

- Cisco Package Contact Center Enterprise(PCCE)リリース12.5

- CVPリリース12.5

- Cisco Virtualized Voice Browser(CVVB)12.5

- Cisco Unified Border Element(CUBE)または音声ゲートウェイ(GW)

- Google Dialogflow

使用するコンポーネント

このドキュメントの情報は、次のソフトウェアのバージョンに基づいています。

- Cisco Package Contact Center Enterprise(PCCE)リリース12.5

- CVPリリース12.5

- Cisco Virtualized Voice Browser(CVVB)12.5

- Google Dialogflow

このドキュメントの情報は、特定のラボ環境にあるデバイスに基づいて作成されました。このドキュメントで使用するすべてのデバイスは、クリアな(デフォルト)設定で作業を開始しています。対象のネットワークが実稼働中である場合には、どのようなコマンドについても、その潜在的な影響について確実に理解しておく必要があります。

背景

CVP 12.5では、Customer Virtual Assistant(CVA)機能が導入されています。この機能では、サードパーティベンダーのテキスト音声変換(TTS)、自動音声認識(ASR)、および自然言語処理(NLP)サービスを使用できます。

注:このリリースでは、Google NLPのみがサポートされています。

この機能は、人と同様の対話をサポートし、自然言語処理による音声自動応答(IVR)内で問題を迅速かつ効率的に解決できるようにします。

Cisco CVAは、次の対話モードを提供します。

- ローカルインタラクション:プロンプトはWAVファイルを使用してローカルで再生され、ユーザ入力はDTMF文法を使用してキャプチャされます。

- MRCPベースのインタラクション:音声ガイダンスは、TTS機能用のメディアリソースコントロールプロトコル(MRCP)統合コマンドを介して、オンプレミスベースの外部メディアサーバによって再生されます。プロンプトは、ASRによって事前定義された文法に基づいて外部メディアサーバによって認識されます。

- 自然言語理解(NLU):この機能を使用すると、自然言語を理解するように訓練されたクラウドベースの自然言語処理(NLP)エンジンとの対話によって対話を開始できます。

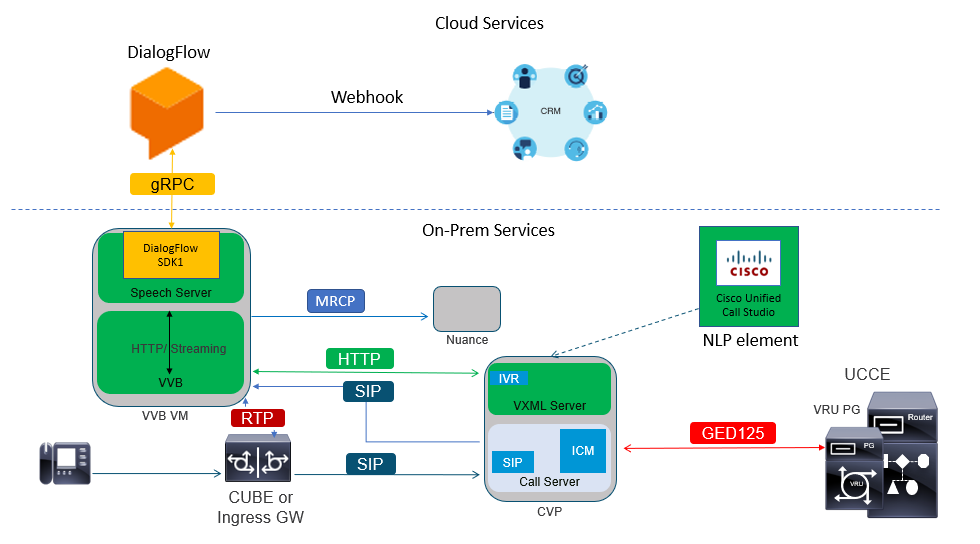

アーキテクチャ

CVPの包括的なコールフローに必要なコンポーネントに加えて、CVAではクラウドサービス、音声サービス、および特定のCVP Call Studio要素を実装する必要があります。CVAに必要なすべてのコンポーネントのリストを次に示します。

- 入力、出力、CUBEゲートウェイ

- Unified Customer Voice Portal(Unified CVP)ソリューション(Call Studioを含む)

- Unified Contact Center Enterprise(Unified CCE)

- Cisco Virtualized Voice Browser(VVB) – 音声サービス

- クラウドサービス(Google Dialogflow)

Cisco CVAのコールフロー

Google Dialogflowでサポートされる主なCVAコールフローは3つあります。

- GoogleベースのIVRロジック(Dialogflow )

- プレミスベースのインテント(DialogflowIntent / DialogflowParam)

- 反訳

GoogleベースのIVRロジック(Dialogflow)

ホステッドIVRの導入は、IVRインフラストラクチャのクラウドへの移行を計画しているお客様に最適です。ホステッドIVR展開では、エージェントがオンプレミスインフラストラクチャに登録されているのに対し、IVRビジネスロジックのみがクラウドに存在します。

ホステッドIVRが導入されると、コア信号とメディアプロセスがクラウドで発生します。さらに、CVPとCisco VVBソリューションは、メディアがクラウドにストリーミングされるブリッジモードになります。IVRが完了し、エージェントが必要になると、コール制御はCVPに戻され、コールの以降の処理とキュー処理が行われます。

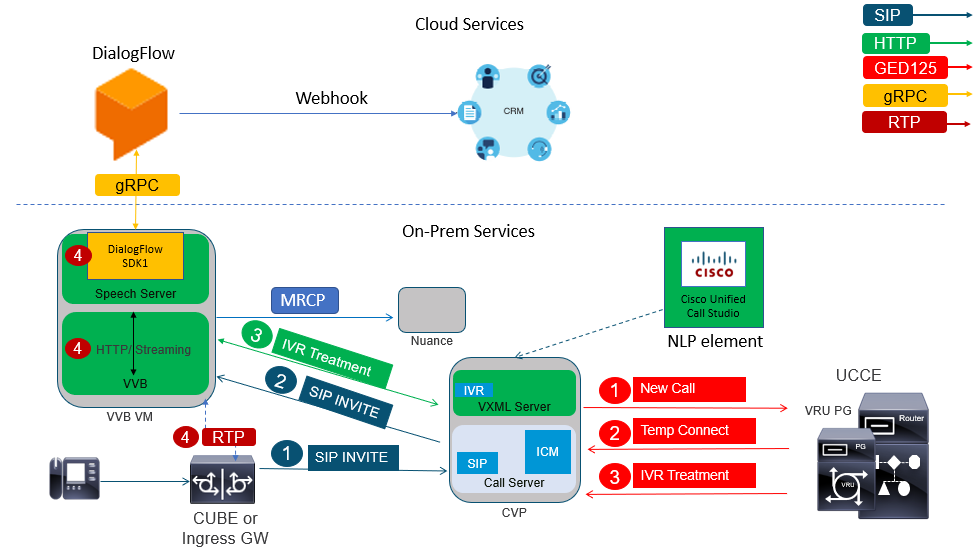

コール フローの例を次に示します。

- コールはCUBEまたは入力ゲートウェイからCVP Call Serverに送信されます。その後、コールはCVPからUnified CCE/パッケージCCEに送信されます。

- CCEは、Cisco VVBでVRU/IVR処理を設定する指示とともに、CVPに一時的な接続を送信します。

- CCEはCVPに対し、VXMLサーバに導入されているcall studioアプリケーションを実行するように指示します。CVPがコールをCisco VVBに送信し、IVR処理が開始されます。音声(RTP)は、Cisco VVBとCUBEまたは入力ゲートウェイとの間で確立されます。この時点までのコールフローのステップは、通常の包括的なコールフローと同じです。次の手順は、CVA Dialogflowコールフローに固有です。

- お客様の音声は、Cisco VVBのSpeech Serverを使用してGoogle Dialogflowにストリーミングされます。

a. Dialogflowでストリームが受信されると、認識が行われ、NLUサービスが実行されて目的が識別されます。

b. NLUサービスはインテントを識別します。インテントの識別は、クラウドで作成された仮想エージェントに基づいて行われます。

c. Dialogflowは、後続のプロンプトを次のいずれかの方法でCisco VVBに返します(call studioアプリケーションの設定によって異なります)。

音声:DialogflowはAPI応答で音声ペイロードを返します。

Text:Dialogflowは、応答としてテキストプロンプトを返します。このプロンプトはTTSサービスによって合成される必要があります。

d. Cisco VVBは、発信者に追加情報の入力を求めるプロンプトを再生します。

e. 発信者が応答すると、Cisco VVBはDialogflowにこの応答をストリームします。

f. Dialogflowはフルフィルメントを実行し、次の2つの方法のいずれかでプロンプトで再度応答します。

オーディオ:Dialogflowは、WebHookを使用してフルフィルメント音声を含むAPI応答でオーディオペイロードを返します。

Text:Dialogflowは、Webフックの使用に応答して、フルフィルメントテキストを含むテキストプロンプトを返します。これはTTSサービスによって合成されます。

g. Dialogflowは、会話全体のコンテキスト管理とセッション管理を実行します。

フロー制御は、お客様がエージェント転送を要求するか、コールが切断されない限り、Dialogflowで維持されます。

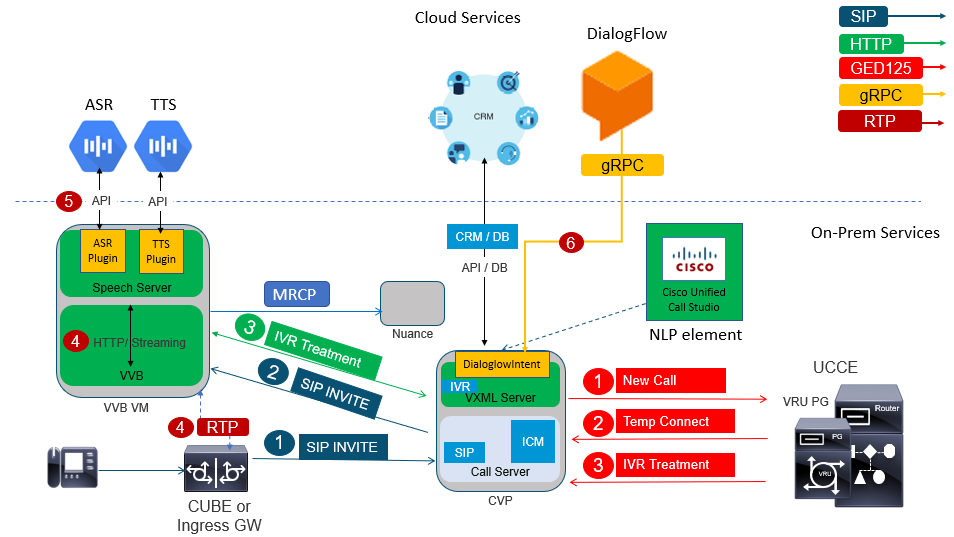

前提ベースのインテント(DialogflowIntent / DialogflowParam)

プレミスベースのインテントデプロイメントは、個人ID情報(PII)またはその他の機密データをオンプレミスシステムで処理する必要があるお客様に適しています。通常、このような導入では、個人ID情報(PII)はクラウドに送信されて処理されることはありません。代わりに、情報が常にオンプレミスで保持および処理されるように収集されます。このコールフローでは、ほとんどのプロセス制御はVXMLサーバで行われます。このコールフローでは次のことが可能です。

- ローカルパラメータプロンプト/シーケンス

- ローカルDTMFの検出

- 現在のアプリケーションの拡張

- ローカル履行

このコールフローは、コールスタジオのDialogflowIntent要素とDialogflowParamt要素を使用します。手順1 ~ 3は、前のDialogflowコールフローと同じです。以降の手順は次のとおりです

- お客様の音声は、Cisco VVBのSpeech Server経由でGoogle Dialogflowにストリーミングされます。

- このシナリオでは、音声サーバが音声をクラウドASRに渡します

- ストリームがGoogleで受信されると、認識が行われ、テキストがVXML Serverに返されます。VXMLサーバはこのテキストをDialogflowに渡し、NLUサービスが目的を識別します。NLUは、設定済みのインテントを識別します。インテントの識別は、クラウドで作成された仮想エージェントに基づいて行われます。

a. Google Dialogflowは、VXML Serverに導入されたCall Studioアプリケーションにインテントを返します。

b.識別されたインテントが、クレジットカード番号や暗証番号などの機密情報の処理を必要とする場合、

入力すると、Cisco VVBは必要なプロンプトを再生し、エンドカスタマーからDual Tone Multy Frequency(DTMF)を収集できます。

c.この機密情報は、ローカルのビジネスアプリケーションによって収集され、認証および次の目的で顧客関係管理(CRM)データベースに送信されます

プロセス.

d.顧客がPINを使用して認証されると、音声制御をクラウドのASRサービスに戻すことができます。

e. Call Studioアプリケーションを介したVXML Serverは、会話全体のコンテキスト管理とセッション管理を実行します。

基本的に、このコールフローは、お客様からの情報に基づいて各段階で実行されるアクションを定義するという点で、はるかに柔軟性に富んでおり、オンプレミスのアプリケーションだけで実行されます。クラウドサービスは、主に音声と意図の認識に取り組んでいます。意図が特定されると、制御がCVPビジネスアプリケーションに戻され、次のステップを処理して決定します。

反訳

このコールフローは、音声からテキスト文(基本的にはASR)へのカスタマー入力変換を提供します。

設定

Dialogflowプロジェクト/仮想エージェント

CVA設定を開始する前に、Google Dialogflowを設定してCisco Speech Serverに接続する必要があります。Googleサービスアカウント、Googleプロジェクト、およびDialogflow仮想エージェントが必要です。次に、このDialogflow仮想エージェントに自然言語を教えることで、エージェントは自然言語処理を使用して顧客との対話に応答できます。

Dialogflowとは

Google Dialogflowは、デバイス、アプリケーション、およびサービスに対してブランド固有の自然な言語対話を可能にする対話型のユーザエクスペリエンス(UX)プラットフォームです。つまり、DialogflowはNLP/NLU(Natural Language Understanding)サービスを提供するフレームワークです。シスコはCVA向けのGoogle Dialogflowと統合しています。

これは御社にとってどのような意味がありますか。つまり、基本的にDialogflowで仮想エージェントを作成し、それをCisco Contact Center Enterpriseと統合できます。

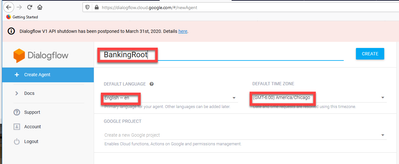

次に、仮想エージェントまたはDialogflowプロジェクトを作成する手順を示します。

ステップ 1: Googleアカウント/プロジェクトを作成するか、シスコパートナーから割り当てられたGoogleプロジェクトを所有します。

ステップ 2:Dialogflowにログインします。https://dialogflow.com/ に移動します。

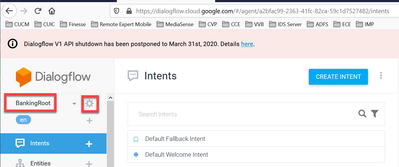

ステップ 3:新しいエージェントを作成します。新しいエージェントの名前とデフォルトのタイムゾーンを選択します。言語は英語に設定してください。CREATE AGENTをクリックします。

この例では、仮想エージェントが銀行取引を処理するため、この実習のエージェントの名前はBankingRootです。言語は英語で、タイムゾーンはデフォルトのシステム時刻です。

ステップ 4:CREATEタブをクリックします。

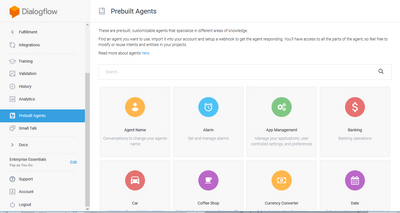

ステップ 5:仮想エージェントを作成した後、次の図に示すように、ビルド前のGoogle仮想エージェントをインポートするか、発信者との通信方法をエージェントに教えることができます。

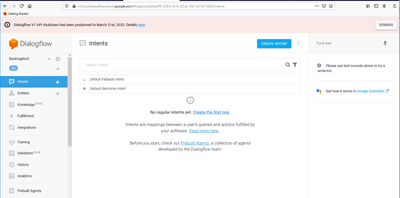

手順 6:この時点では、エージェントはユーザの入力に応答する方法をまだ認識していません。次のステップは、それがどのように振る舞うかを教えることです。最初に、エージェントのパーソナリティをモデル化し、helloデフォルトのウェルカムインテントに応答させて自身を提示します。エージェントが作成されると、次のイメージが表示されます。

注:helloは、call studioアプリケーション要素のDialogflowのデフォルトのウェルカムインテントとして定義できます。

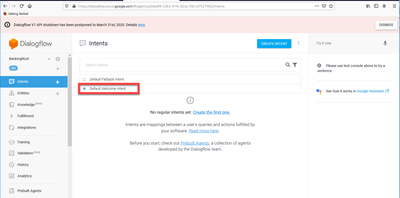

手順 7:Default Welcome Intentをクリックします。

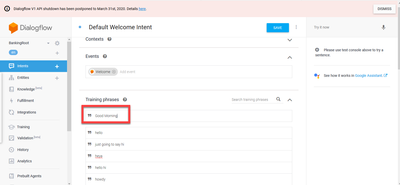

ステップ 8:Training phrasesにHello、Good Morning、およびGood Afternoonを追加します。テキストフォームに入力し、それぞれの後にEnterキーを押します。

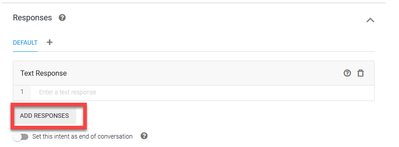

ステップ 9:次に、Responsesまでスクロールして、ADD RESPONSESをクリックします。

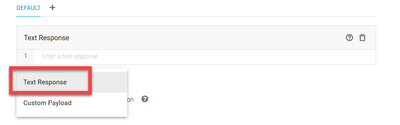

ステップ 10:「テキスト応答」を選択します。

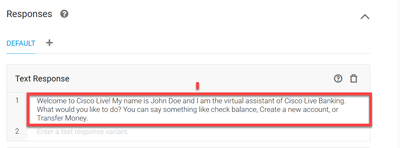

トレーニングフレーズで行ったように、適切な応答を追加します。これは、ユーザがエージェントから受信する最初のメッセージです。エージェントの声をより自然で会話に近づけるために、通常の会話を考え、エージェントが何を言うかを想像してください。それでも、インタラクションが人工知能(AI)エージェントであることをユーザに知らせることは良い方法です。このシナリオでは、Cisco Live Bankingアプリケーションを例として使用します。Cisco Liveへようこそ!私はCisco Live Bankingの仮想アシスタントであるJohn Doeと申します。あなたは何をしたいですか。残高の確認、新しい口座の作成、お金の振り替えなどができます。

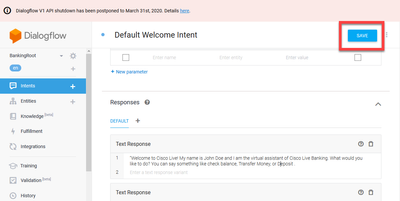

ステップ 11[Save] をクリックします。

さらにインテントを作成する前に、エンティティを作成します。Entityは、Dialogflowがユーザからの要求に応答するために使用できるプロパティまたはパラメータです。通常、エンティティは勘定科目の種類、日付、場所などのインテント内のキーワードです。したがって、インテンツを追加する前に、口座タイプ、預金タイプ、および転送タイプのエンティティを追加します。

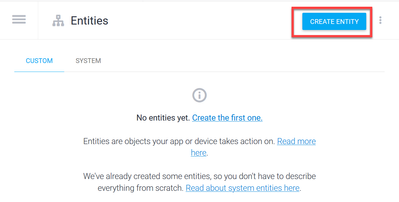

ステップ 12Dialogflowメニューで、Entitiesをクリックします。

ステップ 13「エンティティ」ウィンドウで、「エンティティ作成」をクリックします。

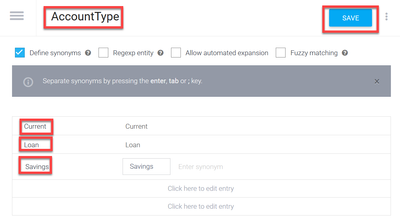

ステップ 14:エンティティ名に「AccountType」と入力します。「シノニムの定義」フィールドに「Current, Loan and Savings」と入力し、「保存」をクリックします。

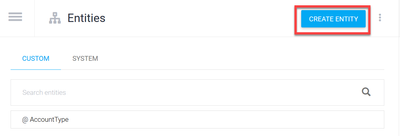

ステップ 15:Dialogflowメニューに戻り、もう一度Entitiesをクリックします。次に、EntitiesウィンドウでCREATE ENTITYをクリックします。

>

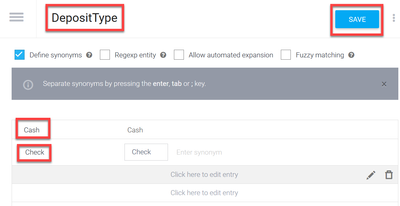

ステップ 16: エンティティ名に「DepositType」と入力します。「シノニムの定義」フィールドに「現金と小切手」と入力し、「保存」をクリックします。

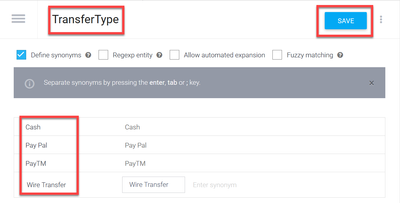

ステップ 17:TransferTypeやDefine synonymsフィールドタイプCash、Pay Pal、PayTM、Wire Transferなど、さらに多くのエンティティを作成できます。

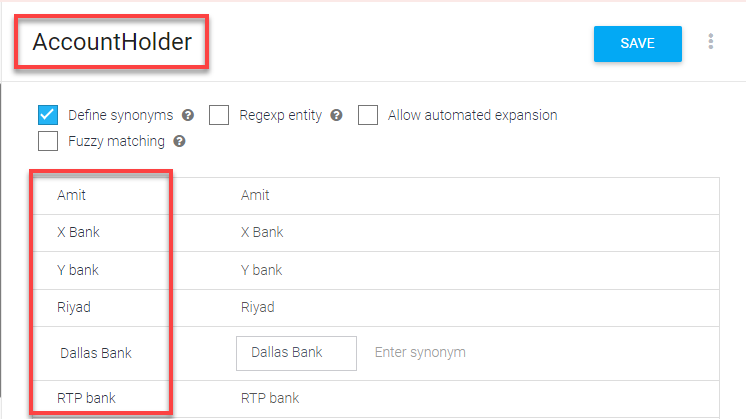

ステップ 18:口座所有者エンティティを作成します。「エンティティ名」フィールドに「AccountHolder;」と入力し、「シノニムの定義」フィールドに入力します。

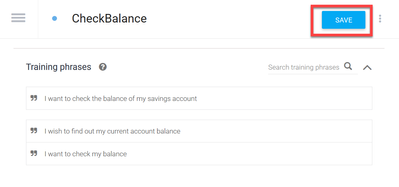

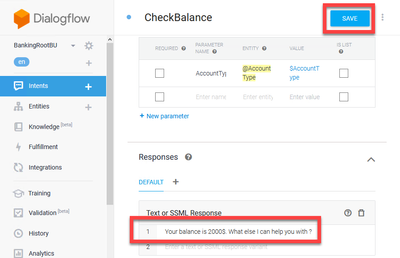

ステップ 19:ここで、銀行システムで受け取ったすべての可能な質問と一般的な回答でエージェントの教育を続けます。次のインテントCheckBalance、TransferMoneyを作成します。CheckBalanceの目的で、次の図に示すトレーニング語句を追加できます。

次の応答を追加することもできます。

ステップ 20:残りのインテント(TransferMoney、CreateAccountおよびExit)、トレーニングフレーズ、パラメータ、および応答を追加できます。

注:Google Dialogflowの設定の詳細については、DialogFlow Virtual Agentを参照してください。

CVVB Speech Serverの設定

Speech Serverは、Cisco VVBに統合された新しいコンポーネントです。Speech Serverは、Googleが最初に開発したオープンソースのリモートプロシージャコール(gRPC)システムを介してGoogle Dialog Flowと対話します

ステップ 1:PCCE管理ワークステーション(AW)、CVP、およびCVVB間で証明書を交換していない場合は、交換します。展開がUCCE上にある場合は、CVP New Operations Manager(NOAMP)サーバ、CVP、およびCVVB間で証明書を交換します。

注:PCCE証明書の交換については、『PCCEソリューションでの自己署名証明書』および『SPOGのPCCEコンポーネント証明書の管理』を参照してください。UCCEについては、『UCCEで交換される自己署名証明書』を参照してください。

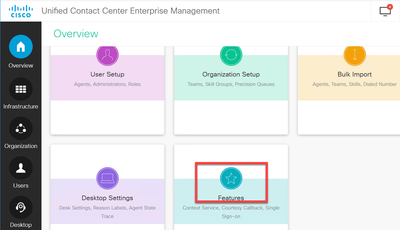

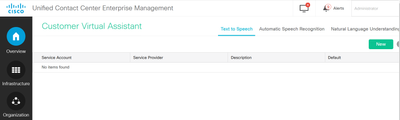

ステップ 2:PCCEで、CCE Admin/Single Plane of Glass(SPOG)インターフェイスを開きます。デピメントがUCCEにある場合は、NOAMPサーバで次の手順を実行します。

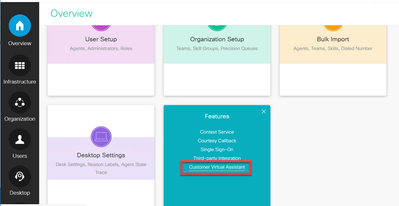

ステップ 3:Featuresの下で、Customer Virtual Assistantを選択します。

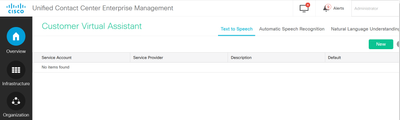

ステップ 4:これで、「音声合成」、「自動音声認識」、「自然言語理解」の3つのタブが表示されます。

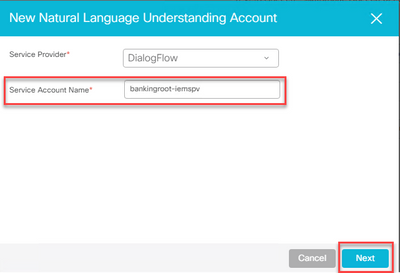

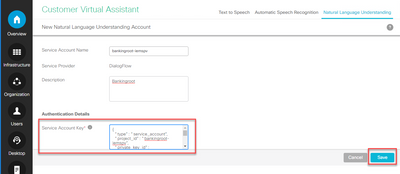

ステップ 5:Natural Language Understandingをクリックし、次にNewをクリックします。

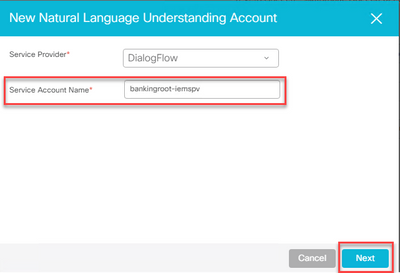

手順 6:New Natural Language Understanding Accountウィンドウで、サービスプロバイダーとしてDialogflowを選択します。

手順 7:サービスアカウント名には、Google Dialogflowで作成した仮想エージェントに関連するGoogleプロジェクトを指定する必要があります。

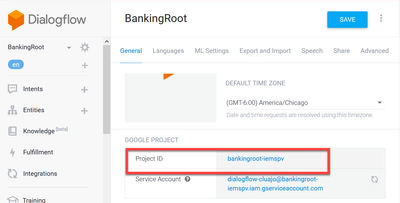

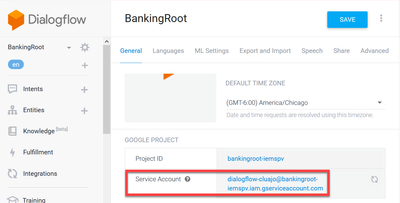

作成された仮想エージェントに関連するプロジェクトを特定するには、次の手順を実行します。

a. DialogFlowアカウント(dialogflow.com)にログインし、作成したエージェントを選択して、設定アイコンをクリックします。

b.右側の設定ウィンドウを下にスクロールすると、サービスアカウントとプロジェクトIDが表示されます。プロジェクトIDをコピーします。これは、Speech Serverの設定に追加する必要があるサービスアカウント名です。

ステップ8:顧客の意図を特定して対応するために必要なGoogleダイアログフローAPIを使用するには、仮想エージェントのサービスアカウントに関連付けられた秘密キーを取得する必要があります。

秘密キーは、サービスアカウントの作成時にJSONファイルとしてダウンロードされます。仮想エージェントの秘密キーを取得するには、次の手順に従います。

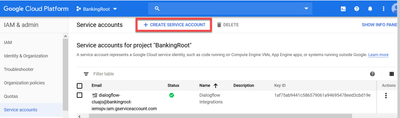

注:プロジェクトに関連付けられているデフォルトのGoogleサービスアカウントを使用する代わりに、新しいサービスアカウントを作成する必要があります。

a. Google Projectセクションで、サービスアカウントのURLをクリックします。

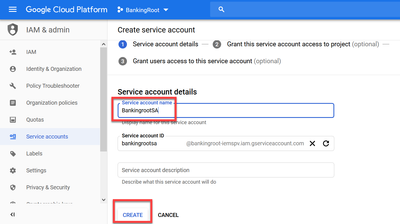

b. Google Cloud Platformサービスアカウントページが表示されます。まず、サービスアカウントにロールを追加する必要があります。ページの上部にあるCreate Service Accountボタンをクリックします。

c.ポップアップで、サービスアカウントの名前を入力します。この場合は、BankingRootSAと入力し、CREATEをクリックします。

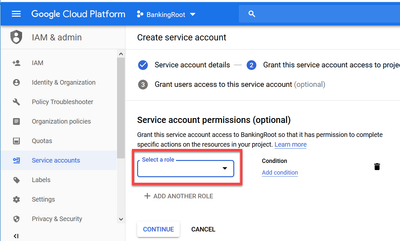

d. Select a roleをクリックします。

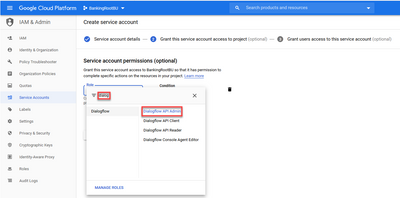

e. Dialogflowカテゴリの下で、目的のロールを選択します。Dialogflow API Adminを選択し、Continueをクリックします。

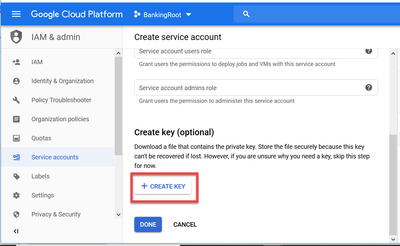

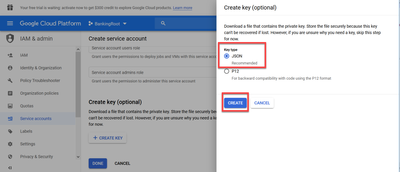

f.下にスクロールして、CREATE KEYを選択します。

g. Private Keyウィンドウで、Key typeにJSONが選択されていることを確認し、CREATEをクリックします。

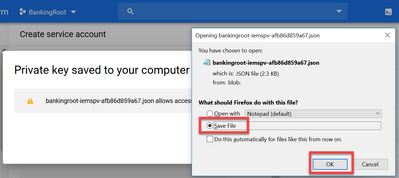

h. JSONファイルのダウンロードが開始されます。Save Fileボックスにチェックマークを入れ、保存場所を選択して確認します。

注意:このJSONファイルは一度だけダウンロードできます。そのため、ファイルを保存して安全な場所に保管してください。このキーが失われたり、セキュリティ侵害を受けたりした場合は、同じプロセスを使用して新しいキーを作成できます。JSONファイルはC:\Downloadフォルダに保存されます

i.完了すると、確認メッセージを含むポップアップが表示されます。[Close] をクリックします。

ステップ 9:NLUアカウントウィンドウでNEXTをクリックした後、認証キーを指定する必要があります。

ステップ10:説明を追加します。JSONファイルをロードするフォルダに移動します。ファイルを編集し、ファイル内のすべての行を選択して、それらをサービスアカウントキーフィールドにコピーします。[Save] をクリックします。

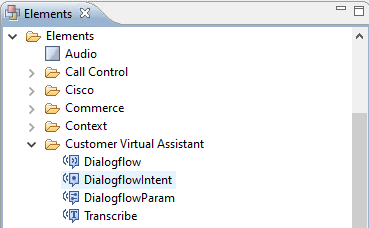

CVP Call Studioの要素

CVP Call Studioリリース12.5が拡張され、次の4つの要素(図を参照)が追加されました。これは、CVA機能の設定を容易にするためです。

各要素について簡単に説明します。

Dialogflow

Dialogflowは、ASR、NLU、およびTTSサービスをクラウドから操作および管理するために作成されました。Dialogflowは、すべての音声サービスがGoogle Dialogflowによって処理され、ビジネスロジック全体が制御され、クラウドから実行されるホステッドIVR導入のシミュレーションに役立ちます。

DialogflowIntent

DialogflowIntentは、クラウドサービスが認識(ASRサービス)およびインテント識別(NLUサービス)に従事するために作成されています。インテントが特定され、CVP VXMLサーバに渡されると、インテントのハンドルおよびその他のアクションをCVP Call Studioスクリプトで実行できます。アプリケーション開発者は、クラウドまたはオンプレミスからTTSサービスを利用できる柔軟性が得られます。

DialogflowParam

DialogflowParamはDialogflowIntent要素と連携して機能します。一般的なオンプレミスベースのIVR導入では、お客様の意図が特定され、VXMLサーバに渡される際に、パラメータの特定が必要であり、CVPアプリケーションによって制御される必要があります。たとえば、一般的なバンキングアプリケーションでは、顧客の会話から逃した入力を分析し、トランザクション全体が処理される前に残りの必須入力を要求できます。上記のシナリオでは、DialogflowParam要素はDialogflowIntent要素と連携して、識別されたインテントを処理し、必要なパラメータを追加します。

反訳

お客様の音声を処理し、テキストを出力として返すために作成されたテキストの書き起こしが作成されています。基本的に認識機能を実行し、テキストを出力として提供します。この要素は、ASR機能だけが必要な場合に使用する必要があります。

これらの各要素におけるパラメータ設定の詳細については、『Element Specifications guide release 12.5』を参照してください。

CVP Call Studioアプリケーション

クラウドベースのインテント処理 – GoogleベースのIVRロジック(Dialogflow)

コールがVXMLアプリケーションに到達すると、Dialogflow要素が引き継ぎ、音声入力の処理を開始します。

お客様との対話は継続され、Google仮想エージェントがインテントを特定して処理できる限り、メディアはTTSサービスを介してリレーされます。 お客様からのすべての質問に対して、フローはDialogflow要素を中心にループ状態で続行され、一致したすべてのインテントが決定ボックスに対して実行されて、IVR処理を続行するかどうか、またはお客様がコールをエージェントに転送する必要があるかどうかを決定します。

エージェントの転送決定がトリガーされると、コールがCVPにルーティングされ、制御が渡されてコールがキューに入れられ、そのコールがエージェントに転送されます。

サンプルのcall studioアプリケーションの設定手順を次に示します。

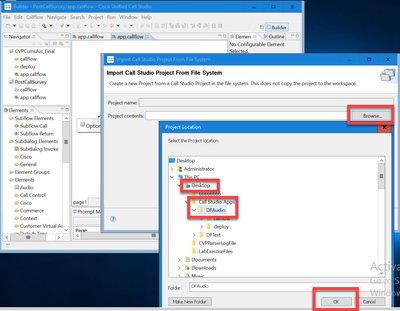

ステップ 1:アプリケーションをCall Studioにインポートするか、新しいアプリケーションを作成します。この例では、DFaudioという名前のCall StudioアプリケーションがCisco Devnet Sample CVA Application-DFAudioからインポートされています。

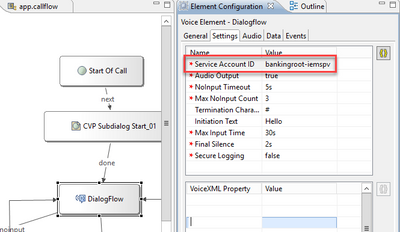

ステップ 2:DFAudioアプリケーションでDialogflow要素を選択し、右側で[設定]タブを選択します。サービスアカウント名を、Speech Serverに以前に追加したプロジェクトIDに変更します。この例では、bankingroot-iemspv

ステップ 3:オーディオをテキストではなくDialogflow仮想エージェントに送信するために、Audio Outputパラメータがtrueに送信されていることを確認します。

ステップ 4:アプリケーションを検証し、保存して、VXMLサーバに展開します。

ステップ 5:次に、アプリケーションをVXMLサーバのメモリに展開します。CVP VXMLサーバでWindows Explorerを開き、C:\Cisco\CVP\VXMLServerに移動してdeployAllNewApps.batをクリックします。アプリケーションが以前にVXMLサーバに展開されている場合は、代わりにUpdateAllApps.batをクリックします。

プレミスベースのインテントプロセス(DialogflowIntent / DialogflowParam)

この例では、コールフローは、顧客が自分の口座残高を確認し、ある金額を預金口座から別の口座に振り替えることができる銀行アプリケーションに関連しています。最初の文字起こし要素は、音声を介して顧客から識別データを収集し、ANI番号で検証します。エンドカスタマーIDが検証されると、コール制御がDialogFlowIntent要素に渡され、お客様からの質問が識別されます。CVP Call Studioアプリケーションは、お客様の入力(転送する量など)に基づいて、エンドカスタマーに残りのパラメータを要求し、その目的をさらに処理します。送金トランザクションが終了すると、お客様は通話を終了するか、エージェントの送金をリクエストするかを選択できます。

ステップ 1:アプリケーションをCall Studioにインポートするか、新しいアプリケーションを作成します。この例では、DFRemoteという名前のCall StudioアプリケーションがCisco Devnet Sample CVA Application-DFRemoteからインポートされています。

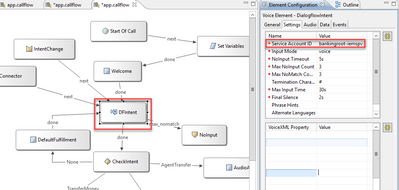

ステップ 2:DFRemoteアプリケーションで、DialogflowIntent (DFIntent)要素を選択し、右側で[設定]タブを選択します。サービスアカウント名を、Speech Serverに以前に追加したプロジェクトIDに変更します。この例では、bankingroot-iemspv

ステップ 3:Input Modeパラメータがvoiceに設定されていることを確認します。音声とDTMFの両方に設定することもできますが、パラメータは収集されないため、この要素は音声に設定する必要があります。DialogflowParamを使用する場合は、両方に設定できます。この要素では、発信者から実際に入力パラメータを収集します。

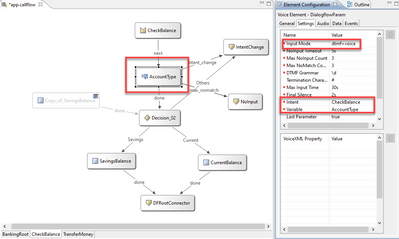

ステップ 4:この例では、顧客が口座残高を確認するコールを発信すると、アプリケーションはDTMFまたは音声で口座タイプを提供するように顧客に求めます。この情報は、DialogflowParam要素(図に示すAccountType)で収集されます。必要なパラメータを収集するには、DialogflowParam設定を変更します。入力モードでdtmf+voiceを選択すると、発信者はアカウントタイプを入力または音声で入力できます。Intentパラメータに、関連するインテントを入力します。この例では、CheckBalanceです。Variable設定では、

インテントのパラメータを選択します。この例では、AccountTypeです。これがインテントの最後のパラメータである場合は、Last Parameter変数をtrueに設定します。DialogflowParam設定の詳細については、『要素仕様ガイドリリース12.5』を参照してください。

ステップ 5:アプリケーションを検証し、保存して、VXMLサーバに展開します。

手順 6:次に、アプリケーションをVXMLサーバのメモリに展開します。CVP VXMLサーバでWindows Explorerを開き、C:\Cisco\CVP\VXMLServerに移動してdeployAllNewApps.batをクリックします。アプリケーションが以前にVXMLサーバに展開されている場合は、代わりにUpdateAllApps.batをクリックします。

手順 7:以前にダウンロードしたJSONファイルをC:\Cisco\CVP\Confディレクトリにコピーします。jasonファイル名はプロジェクト名と一致する必要があります。この例では、bankingroot-iemspv.jsonです。

ステップ 8:Google TTSサービスとASRサービスを追加します(この例のように、これらのサービスが必要な場合)。導入がUCCE上にある場合は、NOAMPサーバを介してTTSとASRを追加します。PCCEで、CCE Admin/Single Plane of Glass(SPOG)インターフェイスを開きます。

ステップ 9:Featuresカードで、Customer Virtual Assistantを選択します。

ステップ 10:最初にTTSサービスを追加してから、同じ手順に従ってASRサービスを追加します。Text to Speechをクリックし、次にNewをクリックします。

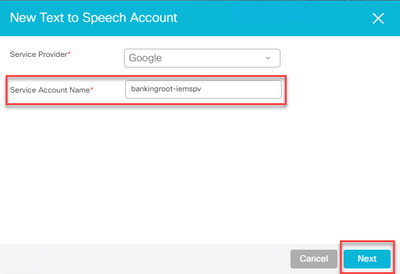

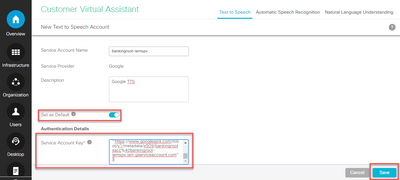

ステップ 11サービスプロバイダーとしてGoogleを選択し、サービスアカウント名(前の手順のNLUアカウントと同じアカウント名)を追加します。[Next] をクリックします。

ステップ 12このTTSサービスをデフォルトとして設定し、前の手順で生成されたNLU jsonファイルの内容をASRおよびTTS jsonキーとしてコピーします。[Save] をクリックします。

注:TTSおよびASRサービスアカウントには、ロールを割り当てる必要はありません。ただし、ASRとTTSに同じNLUサービスアカウントを使用する場合は、このサービスアカウントがTTSとASR APIにアクセスできることを確認する必要があります。

一般的に、DialogflowIntentとDialogflowParamを使用する場合は次のプロセスフローになります。

1. Call Studio/VXMLアプリケーションがC:\Cisco\CVP\Conf\からJSONファイルを読み取る

2. DialogflowIntent音声プロンプトが再生され、音声設定のオーディオファイルまたはTTSが音声に変換されます。

3.ここで、お客様が話すと、音声は認識エンジンのGoogle ASRにストリーミングされます。

4. Google ASRは音声をテキストに変換します。

5.テキストがVXMLサーバからDialogflowに送信されます。

6. Google Dialogflowは、インテントをテキスト形式でVXMLアプリケーションのDialogflowIntent要素に返します。

プロキシサーバの設定

Cisco VVBのGoogle Software Development Kit(SDK)では、gRPCプロトコルを使用してGoogle Dialogflowと対話します。gRPCでは、トランスポートにHTTP/2を使用します。

基盤となるプロトコルはHTTPであるため、Cisco VVBとGoogle Dialogflowの間で直接通信が行われない場合は、エンドツーエンドの通信確立用にHTTPプロキシを設定する必要があります。

プロキシサーバはHTTP 2.0バージョンをサポートしている必要があります。Cisco VVBは、プロキシホストとポートの設定を行うためのCLIコマンドを公開します。

ステップ 1:httpsProxyホストを設定します。

set speechserver httpsProxy host <hostname>

ステップ 2:httpsProxyポートを設定します。

set speechserver httpsProxy port <portNumber>

ステップ 3:Show httpsProxyコマンドを使用して、設定を確認します。

show speechserver httpsProxy host

show speechserver httpsProxy port

ステップ 4:プロキシ設定後にCisco Speech Serverサービスを再起動します。

utils service restart Cisco Speech Serverの起動

また、Premise Based Intent Processing(DialogflowIntent / DialogflowParam)導入モデルを実装しており、CVP VXML ServerとGoogle Dialogflow間に直接インターネット接続がない場合は、CVP VXML Serverでプロキシサーバを設定する必要があります。

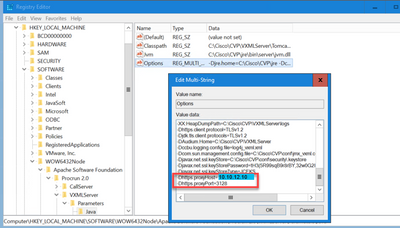

ステップ 1:CVP VXMLサーバにログインします。

ステップ 2:regeditコマンドを実行します。

ステップ 3:HKEY_LOCAL_MACHINE\SOFTWARE\WOW6432Node\Apache Software Foundation\Procrun 2.0\VXMLServer\Parameters\Java\Optionsに移動します。

ステップ 4:これらの行をファイルに追加します。

-Dhttps.proxyHost=<プロキシIP/ホスト>

-Dhttps.proxyPort=<プロキシポート番号>

ステップ 5:サービスCisco CVP VXML Serverを再起動します。

トラブルシュート

CVAの問題をトラブルシューティングする必要がある場合は、このドキュメント『Cisco Customer Virtual Assistant(CVA)のトラブルシューティング』の情報を参照してください。

関連情報

シスコのドキュメント

- サンプルコード

- CVA設計

- OAMPを使用したUCCEでのCVAサービスの設定

- PCCEでのCVAサービスの設定

- Dialogflow Call Studio要素

- DialogflowIntent Call Studio要素

- DialogflowParam Call Studio要素

- Call Studio要素の書き起こし

Googleドキュメント

更新履歴

| 改定 | 発行日 | コメント |

|---|---|---|

2.0 |

18-Dec-2023 |

リリース 2 |

1.0 |

14-May-2020 |

初版 |

シスコ エンジニア提供

- ラミロ・アマヤCisco TACエンジニア

- アヌジ・バティアCisco TACエンジニア

- ロバート・ロジェCisco TACエンジニア

シスコに問い合わせ

- サポート ケースをオープン

- (シスコ サービス契約が必要です。)

フィードバック

フィードバック